보험금 지급 지연·거절로 이어질 경우 소비자보호 리스크 관리 책임 강조

금융당국이 보험사들이 활용 중인 인공지능(AI) 기반 보험사기 탐지 시스템에서 발생할 수 있는 차별 가능성 및 소비자보호 리스크를 공식 가이드라인(안)에 위험 요소로 명시한 것으로 확인됐다. 보험사기 적발 효율을 앞세워 확산된 AI 활용이 특정 병원이나 고객군에 불리하게 작용할 수 있다는 점을 처음으로 문서에 담은 것이다.

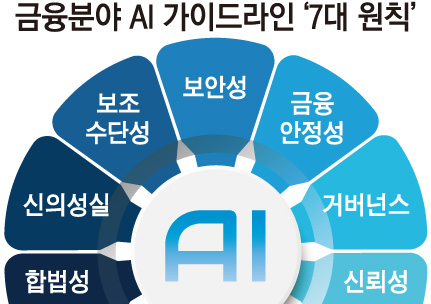

8일 본지가 입수한 ‘금융분야 AI 가이드라인(안)’에는 지난해 12월 22일 금융연구원이 발표한 AI 활용의 7대 원칙을 바탕으로 한 적용 기준과 참고자료, 점검항목, 준수사례(예시) 등이 담겼다.

가이드라인 중 합법성 원칙과 신뢰성 원칙을 설명하는 대목에는 보험사의 보험사기탐지시스템(Fraud Detection System·FDS)에서 발생할 수 있는 편향 사례가 ‘준수사례(예시)’로 담겼다. 문서에는 “C보험사는 보험사기예측시스템(FDS)이 특정 병원의 진료 패턴을 과도하게 ‘사기 의심’으로 분류하는 편향을 발견하고 즉각적인 시정조치 및 근본 원인 분석을 실시하고 이를 개선했다”고 적혔다.

금융당국은 이 사례를 통해 AI 기반 탐지 시스템이 학습 데이터나 알고리즘 구조에 따라 특정 집단이나 거래 유형을 반복적으로 불리하게 평가할 가능성이 있음을 시사했다. 특히 보험사기 탐지 결과가 보험금 지급이나 조사 착수 등 실제 업무 판단에 활용되는 만큼, 이러한 편향이 소비자에게 불이익으로 이어질 수 있다는 점을 관리해야 할 위험 요인으로 보고 있다. 가이드라인은 개인의 권리·의무에 중대한 영향을 미치는 판단이나 평가를 수행하는 AI를 ‘고영향 인공지능’으로 분류할 수 있도록 하고, 이 경우 편향성과 공정성을 신뢰성 원칙의 핵심 점검 항목으로 제시했다.

이번 가이드라인은 법적 구속력을 갖는 규정은 아니며 금융권 자율규제 성격의 모범규준이다. 다만 보험사기 탐지 AI의 편향 가능성이 공식 문서에 명시됐다는 점에서 보험업계 전반에 주는 신호는 작지 않다는 평가가 나온다. AI 판단에 따른 보험금 지급 지연이나 거절이 향후 분쟁이나 소송으로 이어질 경우, 보험사의 관리 책임이 한층 엄격하게 따져질 수 있다는 의미로도 해석된다.

![역대 프로야구 연패·연승 기록, 최종 순위는? [해시태그]](https://img.etoday.co.kr/crop/140/88/2340870.jpg)

![한화에어로 폭발 사고로 5명 사망…경영진 직접 브리핑 나선다 [종합2보]](https://img.etoday.co.kr/crop/140/88/2340707.jpg)

![쉽지 않은 내 집 찾기…평균 2.4개월ㆍ3.8곳 둘러보고 계약한다 [데이터클립]](https://img.etoday.co.kr/crop/140/88/2340884.jpg)

![젠슨 황 “베라 루빈 본격 생산 단계”…삼성·SK하닉 메모리 탑재 [컴퓨텍스2026]](https://img.etoday.co.kr/crop/140/88/2340757.jpg)

![5월 수출 878억달러로 53%↑'역대 최대'⋯슈퍼사이클 반도체 '주도' [종합]](https://img.etoday.co.kr/crop/140/88/2331023.jpg)

![평균 연봉 5천이라는데 내 월급은 왜 이럴까? 아무도 말 안 하는 진짜 현실 연봉 [T같은F]](https://i.ytimg.com/vi/xFoKkSaS9s0/mqdefault.jpg)

![[넥스블록][인기 검색 코인 톱15] 결제·디파이·신원 테마에 관심 집중…스텔라·휴머니티 부각](https://img.etoday.co.kr/crop/85/60/2340899.jpg)

![[넥스블록]바이낸스, 美 주식까지 넘보나…‘올웨더 거래소’ 전환 신호](https://img.etoday.co.kr/crop/85/60/2340817.jpg)

![쉽지 않은 내 집 찾기…평균 2.4개월ㆍ3.8곳 둘러보고 계약한다 [데이터클립]](https://img.etoday.co.kr/crop/300/170/2340884.jpg)

![여름철 외식물가 '껑충'…냉면·삼계탕도 부담 [포토]](https://img.etoday.co.kr/crop/300/190/2340901.jpg)